引言

生成式人工智能(通常简称为生成式AI或GAI)是一种能够根据用户指令或需求生成原创内容的人工智能技术,涵盖了文本、图像、视频、音频以及软件代码等多种形式。相比于传统人工智能,生成式AI的核心优势在于其“数据+模型+产品”的完整体系。通过高级机器学习或深度学习模型,生成式AI能够模拟人类大脑的学习和决策过程,识别并编码海量数据中的模式和关联,精准解析用户的自然语言请求或问题,并生成与之相关的新内容。

2022年ChatGPT的问世不仅标志着生成式人工智能技术的重大突破,更在全球范围内掀起了一场前所未有的创新浪潮。凭借这一技术的迅速崛起,全球第四次生产力革命正在以空前的速度和规模加速推进。至2024年,全球人工智能市场规模已突破1840亿美元,相较2023年增长近500亿美元。预计到2030年,这一数字将超过8260亿美元。[1]

生成式人工智能的迅猛发展正在为全球立法带来前所未有的挑战。随着这一技术的广泛应用,世界各国政府及国际组织已加速推进相关立法进程。企业亟需密切关注法规动态,并灵活应对政策变革,通过技术创新和合规管理,确保在日益激烈的市场竞争中占据领先优势。

一、生成式人工智能的风险类别

(一)生成信息失准

由于生成式人工智能具有“数据+模型+产品”的特性,任何一个环节的失误都可能导致最终产出出现不准确、偏见或误导性的内容。在这些技术问题尚未完全解决之前,行业从业者和律师必须充分认识到这些与这些技术长期共存的风险点。

-

哈布斯堡AI

生成式人工智能模型在大规模互联网数据上进行训练,这些数据本身就可能包含不准确或带有偏见的内容,甚至部分数据来源于其他人工智能的输出。与人类不同,AI目前只能在已有的数据基础上进行训练,而无法直接在物理世界中自行获取经验,因此很难有效区分准确与不准确的信息。这种使用未经清洗数据进行训练的过程,就如同人类在学习时依赖未经审查的错误教材或基于错误的学习笔记。人工智能研究员兼播客主持人Jathan Sadowski将这种基于“近亲繁殖”数据训练,而非依赖人类源数据的AI模型称为“哈布斯堡AI”(Habsburg AI)[2]。

为应对这一挑战,许多科技公司已开始尝试通过改变数据来源来提高AI模型的质量。例如,英伟达推出的Omniverse Replicator,旨在利用实地数据与物理原理相结合生成合成数据,从而改进人工智能的训练过程。

-

AI幻觉

生成式AI模型的基础技术主要依赖于词元(Token)拆分和权重计算来决定生成文本序列,而非人类的逻辑推理。这种基于统计的叠加权重计算方法,虽然在处理大规模数据时表现出色,但也伴随着无法避免的错误输出。当训练数据量过大时,AI可能会检测到训练数据中实际上并不重要的方面,导致“过度拟合”(Overfitting)。这些技术问题会导致AI给出一些现实中不会出现的答案,这种输出错误被称为AI幻觉(AI Hallucination)[3]。

有关AI幻觉的最著名例证是Mata v. Avianca案[4]。在此案中,一名纽约律师代表客户的伤害索赔,依赖ChatGPT进行法律研究,引用了ChatGPT编造的案例。很多科技公司也在尝试解决这一问题,比如谷歌最新退出的DataGemma,就是尝试通过交错检索生成技术(RIG)来提高输出内容的准确性、减少AI幻觉。OpenAI最新退出的o1-preview也在尝试使用增强学习模型模拟训练人类思考问题,进一步优化GAI的逻辑推理和解决复杂问题的能力。

-

对AI生成信息的过度依赖

生成式AI产品的设计初衷并非用于区分真伪,其主要功能是生成模仿人类语言的内容,而非验证信息的真实性。在实际应用中,产品的设计目的与用户的需求常常存在错配,导致用户在未经过验证的情况下可能接受错误的AI输出。此外,研究表明,在人机共同决策的过程中,人类往往倾向于过度依赖AI系统的建议。[5]这种现象不仅可能导致决策失误,还可能加剧对AI技术的过度依赖。

这些问题要求AI产品的开发者与用户在使用协议及其他应用场景中对产品的功能和目的达成共识,并建立公平合理的风险分配机制。开发者应清楚告知用户AI产品的局限性和潜在风险,而用户在依赖AI输出前也有责任进行必要的验证和审查,以避免盲目信任。

(二)知识产权(IP)相关风险

生成式AI的广泛应用和推广引发了新的知识产权问题,为知识产权持有人、AI开发者以及AI用户带来了前所未有的商业风险。这些问题包括生成内容的归属、模型训练过程中使用的版权材料的合法性,以及由AI创作的作品是否享有知识产权保护等复杂议题。随着生成式AI技术的持续发展,各方需要在法律框架、商业实践和技术创新中权衡利益。

-

IP侵权

在训练过程中,许多人工智能系统抓取并使用受知识产权保护的内容,因而这一训练过程、训练后的AI模型及其生成的内容均可能涉及知识产权侵权的风险。目前,现有的知识产权侵权案件主要集中在版权和商标问题上,但未来也可能涉及专利发明、设计图等其他领域。

许多知识产权侵权诉讼目前正在审理中,其中较为知名的案件是Getty Images vs. Stability AI[6],该案件中,Stability AI被指控在未经授权或补偿的情况下使用超过1200万张受著作权保护的图像进行训练,以开发其文本转图像工具。

由于AI训练的特殊行,这类侵权案件的原告可能面临一些特殊挑战。首先,生成式AI公司的训练过程通常缺乏透明度,原告几乎无法获得训练数据包,以证明其使用了受保护的文献。其次,人工智能的输入与输出之间并不存在稳定的因果关系,很多时候,输出的内容是基于多个来源的数据共同启发而生成的,并不涉及直接复制。此外,在输出环节,AI与用户的交互过程也增加了复杂性,如果输出内容侵权,如何界定AI公司与用户之间的责任分担,亦是每个侵权案件中需要详细厘清的核心问题。

-

AI输出内容的IP权属

根据目前的美国案例法,人工智能自身不能作为作者或发明者对其生成的内容进行知识产权保护。美国宪法规定,国会有权在有限的时间内确保作者和发明家对其著作和发明的专有权,以此推动科学和实用艺术的进步。[7]然而,宪法并未明确说明“作者”和“发明家”是否可以是人工智能主体。该问题直到2023年Thaler v. Perlmutter案[8](泰勒案)才有了明确的判例。

泰勒案的核心争议在于,人工智能系统自主生成的作品(例如一幅名为“天堂的最近入口”的画作)是否应受到著作权保护。法院深入探讨了著作权法中“作者”的定义,发现该术语在著作权法或宪法中均未明确界定。基于著作权法的立法历史以及宪法旨在激励人类创造力的目的,法院最终认定,著作权保护仅适用于人类创作的作品。

除了著作权,泰勒还尝试为其人工智能系统DABUS设计的两种产品(一个使用分形几何构造的食品容器和一个在紧急情况下吸引注意力的闪烁灯塔)申请专利,但这些申请被美国专利商标局(USPTO)拒绝。该局认为,只有自然人才可以在专利申请中被指定为发明人。在后续的诉讼[9]中,美国联邦巡回上诉法院确认了这一立场,明确指出只有自然人才能成为发明者。

(三)数据及隐私保护

-

保密信息的泄露

在使用生成式AI过程中,用户往往会输入提示词或上传文件,若其中包含保密信息,这些数据不仅有可能被AI平台存储或审查,甚至可能被用于大模型的训练,进而在其他用户的交互中被意外输出。这种保密信息泄露的风险对企业和个人都构成了重大威胁。

为应对此问题,许多科技公司已采取多种措施,如实施数据脱敏、访问控制以及数据加密等技术手段,以保护用户上传的敏感信息。此外,一些公司针对特定客户开发了专用平台,在此类平台中,设立了与大模型隔离的防护机制,确保保密信息不会被同化至大模型中,例如在AI预测蛋白结构的应用中。这些手段有助于增强数据安全性,降低信息泄露风险。

-

侵犯数据隐私权

目前,美国联邦层面尚未通过统一的数据保护法案,最接近全国统一数据保护的法案是美国隐私权法案(American Privacy Rights Act, APRA),该法案目前仍在审议中[10]。在该法案获得通过之前,联邦层面主要通过《联邦贸易委员会法案》(FTC Act)[11]来规范企业的隐私承诺以及个人信息的保护。此外,在金融、医疗和儿童隐私等特定领域,也有相应的法规进行管理。各州也出台了针对数据隐私保护的立法,例如加州在2008年通过的加州消费者隐私法(California Consumer Privacy Act, CCPA)[12]。

生成式AI的基础在于数据集,许多数据集可能包含大量用户的个人信息或基于这些信息生成的衍生数据,而这些数据的获取和使用有时并未经过用户的明确同意或知情授权,这引发了广泛的隐私保护问题。此外,生成式AI的跨州和跨国特性也对不同地区法律的协调性提出了更高的要求。

-

深度伪造(Deepfake)

深度伪造(Deepfake)内容是指由人工智能生成或操纵的音频或视频,这些内容可能让人误以为是真实的,特征在于未经本人同意的情况下,人们似乎说了或做了他们并未实际说过或做过的事情。

未经授权使用或模仿某人的声音或形象,不仅侵犯隐私权,声音和形象的模仿还可能导致声誉损害,还可能引发欺诈或诽谤等法律诉讼。因此,企业和组织在使用视频或语音生成技术时应保持谨慎,确保遵守他人的知识产权和隐私权。例如,可以通过实施内容审核和用户身份验证等措施,来减少深度伪造技术的滥用风险。

(四)AI相关服务和技术跨境的政策性风险

随着人工智能技术的迅猛发展,各国政府出于国家安全和技术竞争的考量,纷纷制定了对高科技出口的管制政策,尤其是针对AI技术、训练数据及相关硬件的出口。这些政策将处于长期的动态调整过程中,要求投资者、行业参与方和观察者持续关注并及时跟进相关变动。

例如,从2020年以来,美国商务部逐步将部分与AI相关的技术纳入其出口管制清单,特别是用于图像识别、语音识别和深度学习的AI算法。近年来,美国进一步限制特定国家和区域(含中国)获取可用于AI训练和运行的高性能计算设备和半导体设备,包括英伟达(NVIDIA)、AMD等公司生产的用于AI模型训练的GPU芯片[13]。

此外,美国总统拜登也在2023年签署了一项行政命令,限制美国对中国关键技术领域的投资。这项命令针对三个主要领域:半导体与微电子、量子信息技术和人工智能[14]。根据相应指定的拟议规则(Advance Notice of Proposed Rulemaking ,ANPRM),在人工智能方面,美国财政部考虑考虑要求美国实体在与中国开发(网络安全、数字取证、渗透测试、机器人控制、窃听设备、定位跟踪或面部识别)等领域的人工智能软件企业进行交易时向财政部报备[15],具体的监管措施仍有待观察美国财政部最终发布的监管政策。

二、美国AI监管框架

在深入探讨人工智能(AI)法律监管框架之前,有必要简要介绍美国的立法体系。美国法律体系由联邦法律和州法律两个层面构成。联邦法律由美国国会制定,通常始于众议院议员的提案,经过众参两院的讨论和通过后,提交总统签署。州法律则由各州的立法机构制定,其立法程序因州而异,州法律主要管辖本州事务。联邦法与州法的关系并非简单的垂直管辖。国会作为联邦立法机构,依据宪法赋予的权力制定涉及跨州贸易、国际贸易、专利法等领域的法律。宪法未授予国会的权力,由各州保留,这意味着在某些领域,州拥有完全的立法权和管理权,不受联邦法律限制。此外,在非联邦独享立法权的领域,如贸易、商标等,各州亦可进行立法规范。若联邦法与州法在某些领域发生冲突,州法律必须根据美国宪法中的最高法律效力条款(Supremacy Clause),在联邦宪法的限度内进行立法。

尽管美国宪法未赋予总统直接参与立法的权力,但总统基于行政权力或国会授权,有权依据宪法监督所有法律的执行。总统作为联邦最高行政首长,可以通过发布“行政命令”对联邦所属各机构进行具有法律效力的指示。这些行政命令通常由政府部门、管理和预算办公室(OMB)或白宫起草,旨在为整个行政系统提供明确指引。

此外,美国作为判例法国家,在司法裁判中采取“遵循先例”原则。根据这一原则,某一判决中的法律规则不仅适用于该案,还通常作为先例适用于未来该法院或下级法院管辖的案件。因此,法官通过审理案件创设案例法先例,实际上参与法律规则的制定过程。

(一)联邦层面及总统行政命令

在联邦层面,美国已发布多项框架性指导原则以治理生成式人工智能。2023年5月,拜登-哈里斯政府更新了国家人工智能研究与开发战略计划,该计划在延续2016年和2019年人工智能发展战略的基础上,重申了此前提出的八项政策,并增加了第九项政策,强调建立规范与协调的国际人工智能研究合作机制,特别关注解决环境可持续发展、医疗保健和制造业等全球性挑战。

总体而言,美国在人工智能治理方面遵循两项基本原则:

1. 创新优先与监管后置:为推动人工智能技术的快速发展,联邦政府一方面加大对相关机构的资金支持,另一方面要求监管保持高度灵活性,以为技术创新创造充足的空间。两党在风险监控的尺度上仍存在严格程度上的一些分歧。在实际的规则制定过程中,可以观察到监管者与顶尖技术公司之间保持密切沟通,许多科技企业也在积极游说政府以降低风险监管的要求。

2. 国家安全与大国竞争:美国高度重视人工智能技术所带来的国家安全挑战,要求政府内部加强对人工智能的培训与安全监管,并强调潜在的网络安全与国家安全风险。未来,美国可能会进一步加强对人工智能相关技术的出口管控,以维护其技术竞争优势并强化技术竞争壁垒。

近年来,联邦政府针对人工智能监管的系列行政命令、法规及政策性文件主要包括:

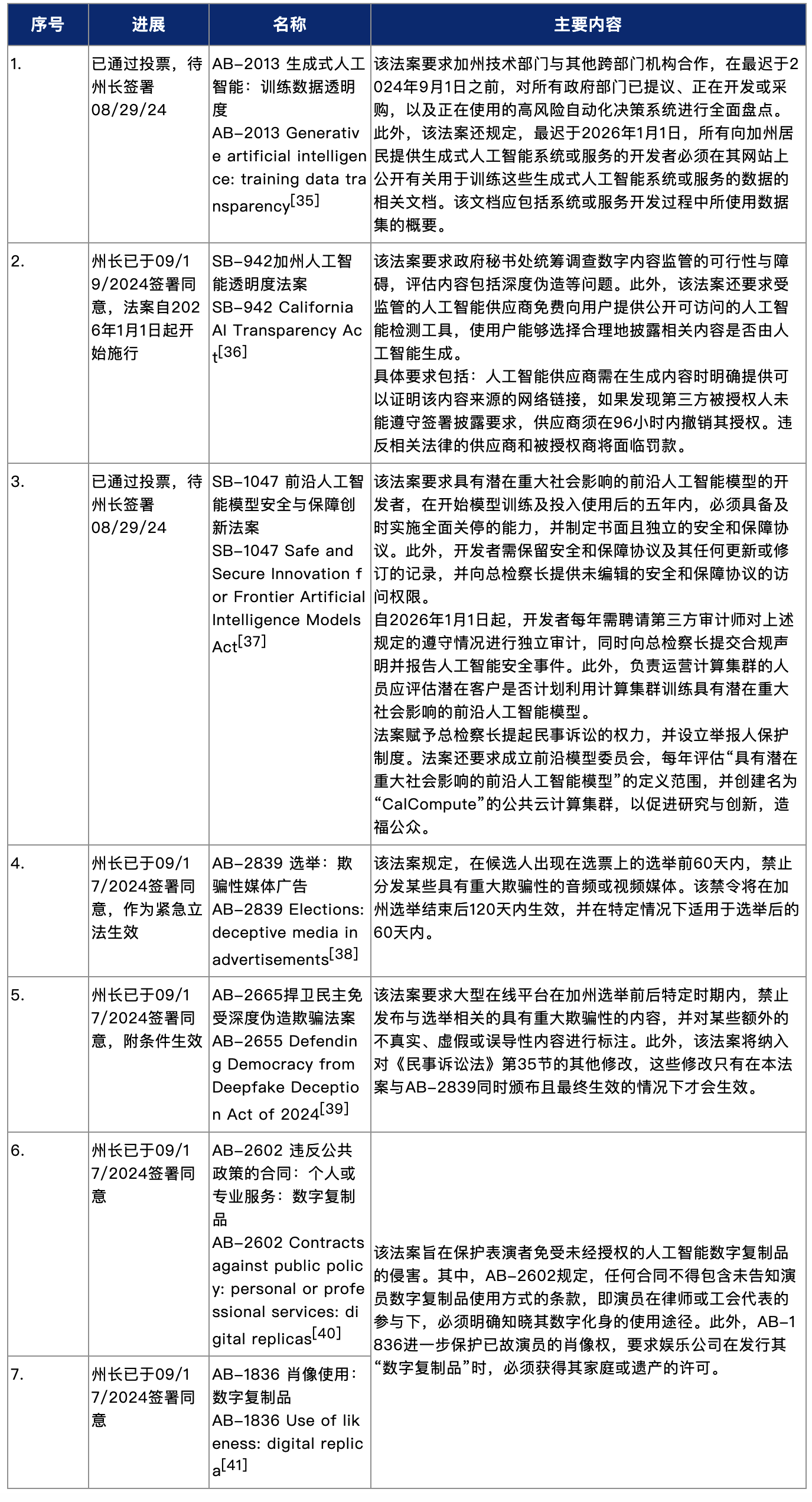

(二)州法层面

目前,美国大部分州正在考虑制定本州的人工智能监管法律,各州的关注重点各不相同。一些州希望在算法和数据监管上采取相对联邦政府更为严格的风险管控策略,而另一些州则希望将重点放在联邦政府较少监管的领域。

以加利福尼亚州为例,加州作为众多人工智能创新的发源地以及美国好莱坞的中心,其当前的立法方向主要聚焦于三个领域:首先,保护表演者免受未经授权的人工智能数字复制品的侵害;其次,禁止在选举中使用由人工智能生成的深度伪造和虚假广告;最后,对具有潜在重大社会影响的前沿人工智能模型的开发者施加较为严格的责任规定。

这些立法措施在产业界、科技界和学术界引发了一定程度的反对声浪,主要反馈意见包括:(1)对言论自由的侵犯:限制大型社交媒体在选举期间发布广告被视为对言论自由的侵犯;(2)对技术创新的限制:人工智能作为一项新兴技术,正处于快速发展阶段,过早立法可能会阻碍技术的创新和进步;以及(3)州法先行的弊端:不同州之间法律的差异可能导致法律环境的复杂性,许多人工智能初创企业需要承受高昂的合规成本和法律资源,以应对复杂的州法和联邦法规定。

(三)案例法层面

除了联邦和州层面的立法,许多与人工智能相关的风险管控还依赖于案例法的发展。除了前文提到案例,以下是一些在AI法律领域具有影响力的著名案例:

-

某短视频社交平台数据隐私案[42]

某短视频社交平台T因其算法自动收集未成年用户的数据而面临多起隐私诉讼,最终达成9200万美元的和解。这起案件展示了AI驱动平台在未成年人数据保护方面的高风险,同时引发了对数据使用透明度的讨论。和解协议规定,T平台需定期发布透明度报告,详细说明其数据处理和安全措施。

-

某数据分析公司数据抓取案[43]

此案涉及某职场社交平台L用户数据的抓取问题。数据分析公司H使用AI技术抓取L公开数据进行分析,L试图阻止这一行为,认为其侵犯了用户隐私。双方最终以和解达成一致,和解协议规定H公司需赔偿L平台50万美元,并立即且永久停止对L平台的数据抓取及基于抓取数据的开发行为。

-

某社交技术公司算法歧视案[44]

美国住房与城市发展部(HUD)指控某社交技术公司M的广告算法在住房广告中存在种族和性别等歧视性行为。M平台的广告投放系统使用机器学习算法,该算法部分依赖于种族、国籍和性别特征,以确定广告商目标受众中的哪些人士实际收到住房广告。此案以和解结案,根据和解协议,M将停止使用依赖歧视性算法的住房广告工具,并开发新系统以解决其广告投放系统中个性化算法导致的种族和其他差异歧视。此外,M平台需向美国政府支付11.5万美元罚款。

-

某电动车公司自动驾驶诉讼

根据美国国家公路交通安全管理局(NHTSA)的分析数据,自2019年以来,某电动车企业T使用的自动驾驶技术(Autopilot)已涉及数百起事故[45]。针对T企业自动驾驶功能的多起诉讼[46]涉及AI技术在驾驶事故中的责任认定问题,挑战了自动驾驶AI系统的安全性、透明性和AI责任分配问题。

这些案例覆盖了AI技术应用的多个关键领域,包括知识产权、隐私、算法公平性、自动驾驶侵权责任等,反映了AI技术在法律实践中所面临的复杂挑战。乔治华盛顿大学的一项公益研究项目正在持续跟踪AI相关的诉讼案例[47],通过判例的发展,法律界和企业可以更好地应对AI带来的新兴法律风险。

三、结语

生成式人工智能的迅猛发展为各个行业带来了前所未有的机遇与挑战。这一技术的应用,不仅推动了生产力的提升,还促进了创新思维的迸发。无论是在医疗、金融、教育还是娱乐等领域,生成式AI都展示出了其变革性的潜力。然而,随之而来的风险与挑战也不容忽视,其固有的不确定性和潜在的滥用问题引发了法律、伦理和社会层面的广泛关注。

在应对这些挑战时,美国正逐步建立一个原则先行、立法后置的AI法律监管框架。这一框架涵盖了多个关键领域,包括技术的公平性与透明性,旨在消除算法偏见,确保AI系统的稳健性和可靠性等。此外,知识产权保护和数据隐私问题也成为监管的重点,以应对生成式AI在内容创作和数据使用中可能引发的法律纠纷和隐私侵犯问题。从全球治理的角度来看,美国非常强调从技术竞争出发,保持AI技术的领先性并促进创新,以强化其AI技术在国际舞台上的领先优势。

在下一篇环球科技法前沿系列中,我们将深入探讨中国的AI法律监管框架。比较中美两国在AI监管方面的差异。我们还将为从事AI业务或购买AI服务的企业用户提供法律合规与风险管控方面的实用建议,帮助他们在快速变化的技术环境中稳步前行,降低潜在的法律风险,抓住发展机遇。

注释:

[1] “Global AI Market Size 2030.” Statista. Retrieved September 12, 2024 (https://www.statista.com/forecasts/1474143/global-ai-market-size).

[2] “What is Habsburg AI?”. Feed the AI. Retrieved September 24, 2024 (https://www.feedtheai.com/what-is-habsburg-ai/)

[3] “What are AI Hallucinations?”. IBM. Retrieved September 24, 2024 (https://www.ibm.com/topics/ai-hallucinations#:~:text=AI%20hallucinations%20are%20when%20a%20large%20language%20model,that%20are%20nonexistent%2C%20creating%20nonsensical%20or%20inaccurate%20outputs.)

[4] “Here’s What Happens When Your Lawyer Uses ChatGPT”, New York Times, Retrieved September 12, 2024 (https://www.nytimes.com/2023/05/27/nyregion/avianca-airline-lawsuit-chatgpt.html).

[5] “AI Overreliance Is a Problem. Are Explanations a Solution?” Retrieved September 13, 2024 (https://hai.stanford.edu/news/ai-overreliance-problem-are-explanations-solution).

[6] Getty Images (US), Inc. v. Stability AI, Inc. Retrieved September 13, 2024 (https://blogs.gwu.edu/law-eti/ai-litigation-database-search/case-detail-page/?pid=94).

[7] Article 1, Section 8 of the U.S. Constitution. “The Congress shall have Power to promote the Progress of Science and useful Arts, by securing for limited Times to Authors and Inventors the exclusive Right to their respective Writings and Discoveries”, Retrieved September 13, 2024 (https://constitution.congress.gov/constitution/).

[8] Thaler v. Perlmutter et al. Retrieved September 13, 2024 (https://blogs.gwu.edu/law-eti/ai-litigation-database-search/case-detail-page/?pid=81).

[9] Thaler v. Commissioner of Patents, Thaler v. Comptroller General of Patents Trade Marks and Designs. Retrieved September 13, 2024 (https://blogs.gwu.edu/law-eti/ai-litigation-database-search/case-detail-page/?pid=51, https://blogs.gwu.edu/law-eti/ai-litigation-database-search/case-detail-page/?pid=50).

[10] H.R.8818 - American Privacy Rights Act of 2024, Retrieved September 13, 2024 (https://www.congress.gov/bill/118th-congress/house-bill/8818/text)

[11] Federal Trade Commission Act, Retrieved September 13, 2024 (https://www.ftc.gov/legal-library/browse/statutes/federal-trade-commission-act)

[12] California Consumer Privacy Act, Retrieved September 13, 2024 (https://www.oag.ca.gov/privacy/ccpa)

[13] 美国商务部对中华人民共和国实施先进计算和半导体制造的出口管制新规,Retrieved September 13, 2024 (https://china.usembassy-china.org.cn/zh/commerce-implements-new-export-controls-on-advanced-computing-and-semiconductor-manufacturing-items-to-the-peoples-republic-of-china-prc/)

[14] Executive Order on Addressing United States Investments in Certain National Security Technologies and Products in Countries of Concern. Retrieved September 13, 2024 (https://www.whitehouse.gov/briefing-room/presidential-actions/2023/08/09/executive-order-on-addressing-united-states-investments-in-certain-national-security-technologies-and-products-in-countries-of-concern/)

[15] Outbound Investment Security Program. Retrieved September 13, 2024 (https://home.treasury.gov/policy-issues/international/outbound-investment-program).

[16] https://www.federalregister.gov/documents/2019/02/14/2019-02544/maintaining-american-leadership-in-artificial-intelligence

[17] https://www.federalregister.gov/documents/2020/12/08/2020-27065/promoting-the-use-of-trustworthy-artificial-intelligence-in-the-federal-government

[18] https://www.whitehouse.gov/briefing-room/presidential-actions/2023/10/30/executive-order-on-the-safe-secure-and-trustworthy-development-and-use-of-artificial-intelligence/

[19] https://www.congress.gov/bill/117th-congress/senate-bill/2551

[20] https://www.congress.gov/116/crpt/hrpt617/CRPT-116hrpt617.pdf

[21] https://www.congress.gov/116/bills/hr133/BILLS-116hr133enr.pdf

[22] https://www.congress.gov/bill/117th-congress/house-bill/6580/text

[23] https://lieu.house.gov/sites/evo-subsites/lieu.house.gov/files/evo-media-document/national-ai-commission-bill.pdf

[24] https://www.congress.gov/bill/118th-congress/senate-bill/1671/text?s=1&r=6

[25] https://www.congress.gov/bill/118th-congress/senate-bill/1873/text

[26] https://www.congress.gov/bill/118th-congress/senate-bill/1865/text

[27] https://www.whitehouse.gov/ostp/ai-bill-of-rights/

[28] https://nvlpubs.nist.gov/nistpubs/ai/NIST.AI.100-1.pdf

[29] https://nvlpubs.nist.gov/nistpubs/ai/NIST.AI.600-1.pdf

[30] https://www.whitehouse.gov/wp-content/uploads/2020/11/M-21-06.pdf

[31] https://www.whitehouse.gov/briefing-room/statements-releases/2023/07/21/fact-sheet-biden-harris-administration-secures-voluntary-commitments-from-leading-artificial-intelligence-companies-to-manage-the-risks-posed-by-ai/

[32] https://www.nist.gov/system/files/documents/2022/12/04/Joint_TTC_Roadmap_Dec2022_Final.pdf

[33] https://www.nscai.gov

[34] https://www.blumenthal.senate.gov/newsroom/press/release/blumenthal-and-hawley-announce-bipartisan-framework-on-artificial-intelligence-legislation

[35] https://digitaldemocracy.calmatters.org/bills/ca_202320240ab2013

[36] https://digitaldemocracy.calmatters.org/bills/ca_202320240sb942?slug=CA_202320240SB942

[37] https://digitaldemocracy.calmatters.org/bills/ca_202320240sb1047?slug=CA_202320240SB1047

[38] https://digitaldemocracy.calmatters.org/bills/ca_202320240ab2839?slug=CA_202320240AB2839

[39] https://digitaldemocracy.calmatters.org/bills/ca_202320240ab2655?slug=CA_202320240AB2655

[40] https://digitaldemocracy.calmatters.org/bills/ca_202320240ab2602?slug=CA_202320240AB2602

[41] https://digitaldemocracy.calmatters.org/bills/ca_202320240ab1836?slug=CA_202320240AB1836

[42] https://news.bloomberglaw.com/privacy-and-data-security/tiktok-92-million-privacy-deal-granted-final-approval-by-judge

[43] https://natlawreview.com/article/hiq-and-linkedin-reach-proposed-settlement-landmark-scraping-case

[44] https://www.justice.gov/opa/pr/justice-department-secures-groundbreaking-settlement-agreement-meta-platforms-formerly-known

[45] https://www.caranddriver.com/news/a44185487/report-tesla-autopilot-crashes-since-2019/

[46] https://news.bloomberglaw.com/product-liability-and-toxics-law/tesla-settles-over-fatal-autopilot-crash-on-eve-of-trial

[47] https://blogs.gwu.edu/law-eti/ai-litigation-database/